在 Dify 的工作流(Workflow)中,LLM 节点和 Agent 节点虽然都能调用大模型,但它们的角色定位完全不同:“LLM 节点是流水线执行者”,而 Agent 节点是“工具箱自动调用者”。

视频教程

一. LLM 节点

LLM 节点是工作流中最基础的逻辑单元。它根据你提供的上下文和提示词(Prompt),产出一个确定的文本结果。

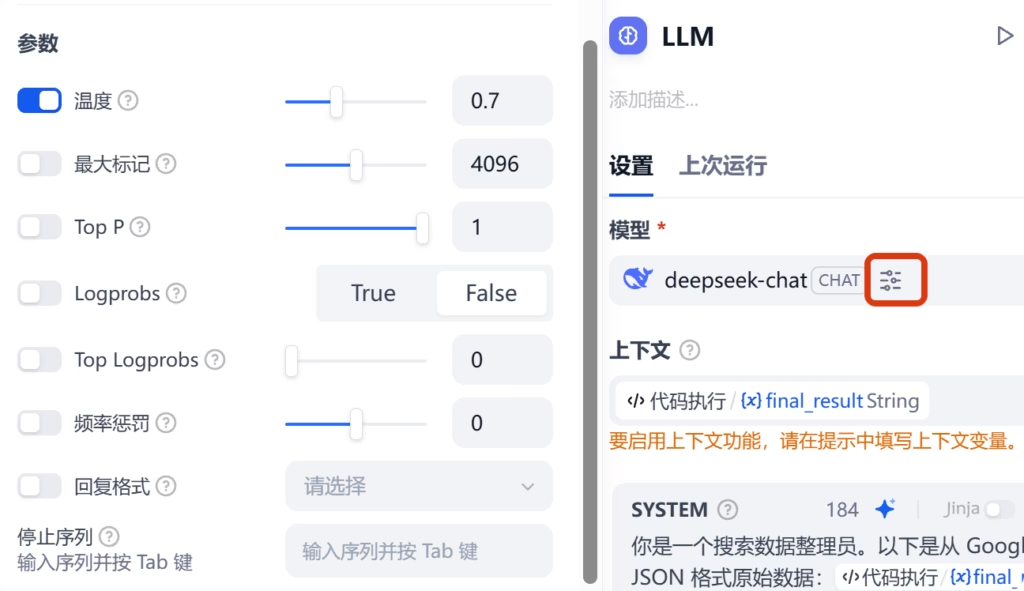

1.1 LLM参数设置

- 模型选择:选择具体的模型(如Gemini3.0, GPT-5, Kimi2.5 等)。

- 温度 (Temperature),控制生成的随机性,数值范围通常为 0 到 2。

- 低温度(如 0.1 – 0.5): 回答更保守、确定,适合写代码、数学计算或总结。

- 高温度(如 0.8 – 1.5): 回答更具创意、多样,但也可能胡言乱语(幻觉),适合写小说或脑暴。

- 默认值 0.7: 平衡了稳定性与灵活性。

- 最大标记 (Max Tokens),限制模型单次输出的最大长度。

- Top P (核采样) :模型在选择下一个词时,只从累积概率达到 P 的候选词中挑选。

- Top P = 1.0: 考虑所有可能的词。

- Top P = 0.1: 只在最顶尖的、概率最高的几个词里挑。

- 建议: 通常建议只调“温度”或“Top P”中的一个,不要两个一起大幅改动。

- Logprobs & Top Logprobs:这是开发调试用的。开启后,模型会告诉你它在选每个词时的“概率分数”。帮你分析模型为什么选了这个词而不是另一个词。普通用户一般不需要开启(设为 False)。

- 频率惩罚 (Frequency Penalty):数值越高,模型越不容易重复一模一样的话,能强制它换个词说话,减少“车轱辘话”。

- 回复格式 (Response Format):指定返回的内容格式。JSON Mode(让模型必须返回标准的 JSON 数据格式,方便程序抓取数据)或 Text(普通文本)。

- 停止序列 (Stop Sequences):当模型预测到你设置的某个特定字符(比如

###或User:)时,它会立刻闭嘴停止生成。常用于对话系统,防止模型自言自语把用户的戏份也给演了。

- 温度 (Temperature),控制生成的随机性,数值范围通常为 0 到 2。

- 上下文:如果你需要引用一些资料或者数据库,可以把它添加到上下文里。

- SYSTEM里填写提示词。如果需要引用前面用户输入的内容或者其他内容,一定点击这个内容框的右上角{x},直接选择,或者在内容里输入/选择。

- 视觉:开启后,模型将具备“看图”,PDF,视频等文件能力。(前提是你上面选择的模型要支持)

- 启用推理标签分离:这是针对带有“思维链”模型的特殊设置。

- 开启:会将模型的“思考过程”和“最终答案”分开。你可以单独获取思考细节,而不让它混在正文中。

- 关闭:思考过程和答案会混在一起输出。

- 输出变量:这一过程输出的内容。

- 失败时重试:网络卡了或出错了,它会自己再试一遍,不用你动手。

- 异常处理:万一彻底死机了,是报错停下还是假装没看见继续走。

参数虽多,基本上都保持默认即可。

1.2 LLM使用场景

适用于任务目标明确、步骤固定的场景。例如:文章摘要、翻译、格式化提取、情感分析等。

二. Agent 节点

Agent节点不仅包含 LLM 的推理能力,还具备了**推理循环(Reasoning Loop)和工具调用(Tool Calling)**能力。它会根据目标自行决定“要做什么”以及“用什么工具做”。

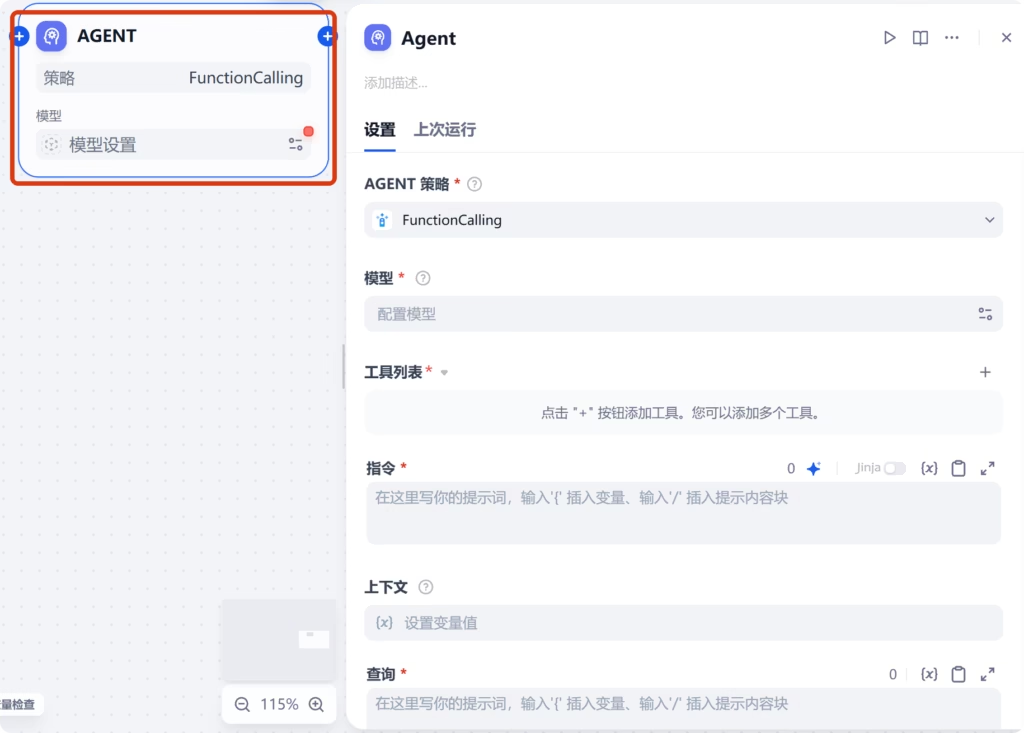

2.1 Agent参数设置

- AGENT策略,可以直接在Dify的工具中下载“Dify Agent 策略”。

- Function Calling:效率最高,直接调用工具。新的模型基本都具备这个能力,首选,省Token。

- ReAct:经典的“思考-行动-观察”循环,适用于通用模型。

- 模型:你想要用的AI大模型。

- 工具列表:原生的大模型只能聊天,通过这里,你可以为其挂载不同的工具(如 Google 搜索、Python 解释器、数据库查询等)。

- 指令:这是 AI 的角色设定和行动指南。告诉 AI:“你是一个资深的翻译官”或者“你是一个幽默的导游”。

- 上下文:外部知识库或历史信息的引用。

- 查询:用户输入或传递给 Agent 的具体问题。

- 最大迭代次数:设置 Agent 最多进行多少轮思考,防止陷入死循环消耗 Token。

- 其他的参数基本上和LLM里一样设置。

2.2 Agent使用场景

适用于复杂、路径不确定的任务。例如:“帮我搜一下最近一周的人工智能新闻,总结后发邮件给老板。”(Agent 会先搜新闻,再总结,最后调用邮件工具,中间过程由它自行安排。)

三. LLM与Agent对比

为了让你更直观地理解,我们可以通过下表进行对比:

| 特性 | LLM 节点 | Agent 节点 |

| 本质角色 | 文本生成器 | 自主决策引擎 |

| 思维模式 | 单向推理(Input -> Output) | 循环推理(Thought -> Action -> Observation) |

| 工具能力 | 无法直接使用外部工具 | 能够自主选择并调用工具 |

| 确定性 | 高。输出高度依赖 Prompt 结构 | 低。路径具有随机性,结果更具灵活性 |

| 消耗成本 | 较低(单次调用) | 较高(多次思考循环和工具交互) |

| 适用范围 | 标准化、流程化的步骤 | 开放式、需要多步协作的任务 |

四. 如何选择?

在搭建 Dify 应用时,可以参考以下逻辑:

- 如果流程是确定的(比如 A 完事了做 B,B 完事了做 C):请全程使用 LLM 节点。这会让你对输出结果有极强的掌控力,且节省 Token。

- 如果流程是动态的(比如需要根据用户的问题临时去查资料、算数据):请使用 Agent 节点。

在大型工作流中,通常会将两者结合。先用 LLM 节点对输入进行预处理,再交给 Agent 节点去执行复杂任务,最后再由 LLM 节点进行格式化输出。

© 文章版权归白小菌所有,🫰欢迎转发分享。未经允许请勿抄袭转载。