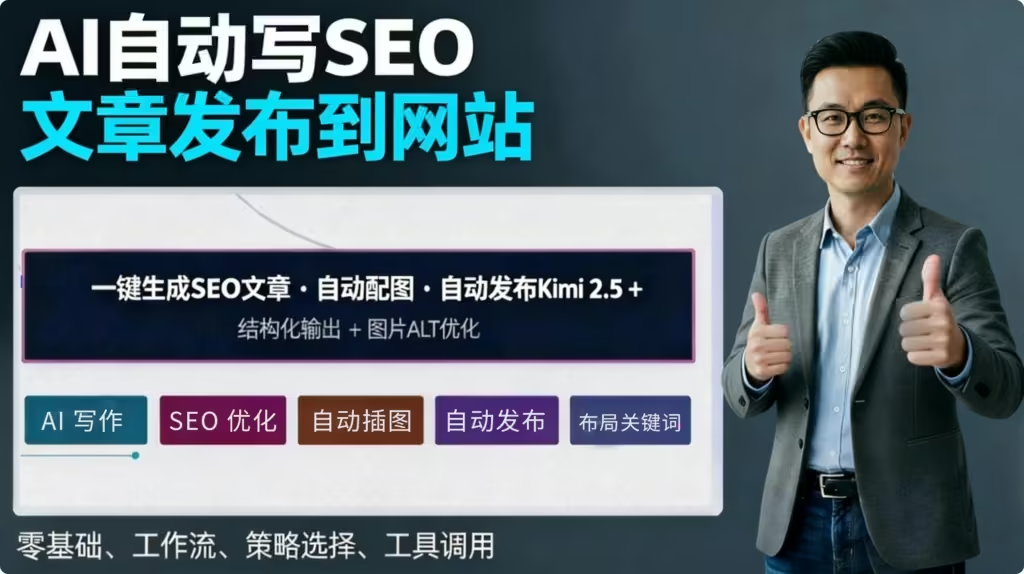

在Dify应用里,知识库就像是给 AI 配备的一个检索来源库,可以通过知识检索节点让AI从我们创建的知识库中寻找答案。尤其是对于一些严谨,具体到自己的某些产品服务,通过 RAG(检索增强生成)技术,你可以让 AI 摆脱“胡说八道”,让它基于你上传的专业文档、产品手册或个人笔记来回答问题。

下面我们将分两步,带你从零建立知识库,并学会如何在工作流中使用它。

一. 创建知识库

在 Dify 首页点击顶部的 “知识库” 标签,点击 “创建知识库”。

1.1 导入数据

Dify提供了多种导入方式:

- 可以直接通过文件/文本txt或者word文档。

- 安装Notion插件,直接从你的Notion笔记中导入。

- 用Dify提供的爬虫工具从网页抓取。

最简单的就是文件导入,其他的方式需要配置一下,不过也简单,按照步骤提示就可以。

小白贴士: 尽量保证文档内容清晰。如果是杂乱的网页内容,建议先手动整理成干净的文本。

1.2 通用分段

AI 大模型(LLM)每次能处理的信息量是有限的,所以文件导入之后还需要对原来的内容进行切分,方便之后的索引。

- 如果不分段: 你上传一份 10 万字的手册,直接塞给 AI,它会因为超过“Token 限制”而罢工,或者出现“中间丢失”现象(只记得开头和结尾,忘了中间)。

- 分段后: 我们把文档切成 500 字左右的小块,AI 只需要阅读与问题最相关的几块,效率极高。

- AI 是按字数(Token)收费的。如果每次回答都要把整个文档读一遍,比较费Token。通过合理的分段,AI 每次只阅读最相关的3-5个片段,这能极大地降低单次对话的成本。

1.3 分段设置

- 分段标识符(Delimiter):

\n\n代表两个换行符。它的意思是:“只要看到文档里空了一行,就从这里切断。”这通常是段落结束的地方。如果你希望切得更细,可以改成\n(看到换行就切)。 - 分段最大长度(Max Chunk Length):每一分段的最大长度。如果一个段落特别长,超过了1024个字符,这个时候即使没有换行分段也会被切断成2部分。通常建议在500-800即可。

- 分段重叠长度(Chunk Overlap):相邻的两段之间,要留下多少“重合”的内容?主要是防止重要的信息被切分,这样第一段的末尾 50 个字会重复出现在第二段的开头,AI 在读任何一段时,都能保留一点上一段的“上下文”记忆。

- 文本预处理规则(Cleaning Rules):

- 替换连续的空格、换行符: 把文档里没用的乱码和多余的空白删掉,让剩下的全是纯干货,帮你的 AI 节省内存(Token)。

- 删除所有 URL 和电子邮件地址: 如果你的文档里有很多没用的链接或邮箱,勾选它。如果这些链接是重要参考资料,就不要勾选。

- 使用 Q&A 分段(QA Segment Mode):这是一个非常强大的功能!Dify 会先读一遍你的文档,自己模拟出用户可能问的问题和对应的答案(比如:“问:这台机器怎么开机?答:按红色按钮”)。

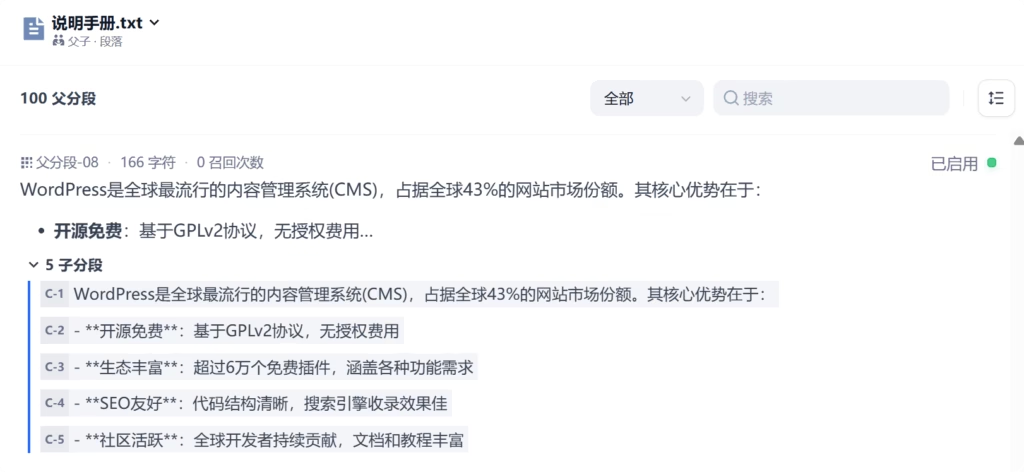

1.4 父子模式

这种模式“大块包小块”。子分段很小,用来让 AI 精准搜索;父分段较大,当AI定位到子分段的位置会联系对应的父分段(简单来说就是参考上下文)给出较完整的答案。

- 分段长度: 建议设置在500-800字符左右。太短了信息支离破碎,太长了 AI 容易抓不住重点。

- 重叠长度(Overlap): 建议设为50-100字符。这就像拼图,两块之间留一点重合的部分,防止核心信息刚好被“切断”。

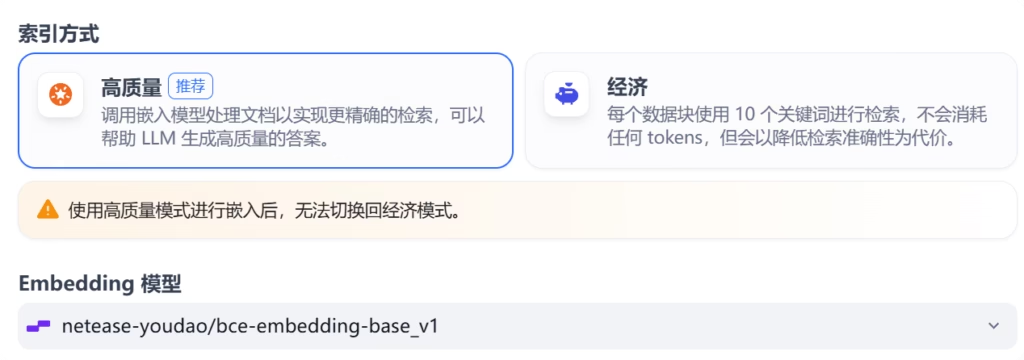

1.5. 索引方式

索引方式分为高质量和经济两种,这直接决定了 AI 搜索知识的“智商”和你的“钱包”支出。

只有上面的分段是通用才能选择经济,父子分段默认就是高质量索引。

高质量模式:它会调用 Embedding(嵌入)模型(如你图中显示的 bce-embedding-base_v1)。它不只是看文字长得像不像,而是把文字转化成一串数字(向量),去理解意思。

- 通俗理解: 如果你搜索“发热”,高质量模式能帮你搜到“感冒、体温升高”的内容。因为它知道这些词虽然长得不一样,但意思相近。

- 优点: 检索非常精准,语义理解能力强,AI 生成的答案更有深度。

- 缺点: 会消耗 Token。因为把文字转成数字这个过程需要调用外部模型扣费(虽然通常很便宜)。

经济模式:它不使用嵌入模型,而是为每个数据块提取 10 个关键词。搜索时,它就像我们在电脑里用 Ctrl + F 搜文件名一样,完全靠关键词碰撞。

- 通俗理解: 如果你搜“发热”,但文档里只有“感冒”,经济模式可能就找不到了,因为它觉得这两个词没一个字母是重合的。

- 优点: 完全免费! 不消耗任何 Token。

- 缺点: 检索准确性较低,容易“答非所问”。

重要提示: 截图里有一行橙色的警告——“使用高质量模式进行嵌入后,无法切换回经济模式”。这意味着如果你之后想省钱,只能删掉这个知识库重新建一个。

1.6 小白怎么选?

| 如果你的需求是… | 建议选择 |

| 给客户用的专业客服机器人 | 高质量模式(为了准确度,这点钱值得花) |

| 处理海量的、对准确度要求不高的草稿笔记 | 经济模式(省钱第一) |

| 文档里有很多表格、对比(如你的 WordPress 表格) | 高质量模式(关键词检索很难搞定复杂的表格逻辑) |

高质量是请了一个“懂行的人”帮你翻书,他知道你要找什么;经济模式是请了一个“只认字的人”帮你翻书,你得说出具体的词他才能找对。

1.7 检索设置

分段是整个流程的基石,它的目的是将长篇大论处理成 AI 容易消化的尺寸。索引将这些分段排序分类。最后的检索就是使用的时候精准把资料调取出来。

- 向量检索 (Vector Search):

- 原理: 把问题转成数字,去搜意思相近的内容。

- 举例:如果你搜“苹果”,它能理解你想找“水果”或“iPhone”,而不是字面上必须有“苹果”两个字。

- 全文检索 (Full-Text Search):

- 原理: 经典的关键词匹配。

- 理解: 你搜什么,它就在文档里找到一模一样的词。

- 混合检索 (Hybrid Search):

- 原理: 同时运行上面两种方式,再把结果合在一起。

- 理解: 既保证意思对得上,又保证关键词没搜错。

如果你选择了【混合检索】,下面还有权重设置和Rerank模型。

- 权重设置:决定了 AI 在搜索时更偏向于“理解意思”还是“匹配字词”。

- Rerank 模型:混合检索会先从库里粗略选出一批候选片段。开启 Rerank 后,系统会调用一个更聪明的模型(如

bce-reranker-base_v1)把这些候选片段和用户的问题放在一起深度对比,重新打分排序。负责剔除不相关的,把最有价值的答案排到第一名。 - Top K:将选出的片段只取最匹配的前N个,通常3-5个即可。

- Score 阈值:搜索出来的片段和问题的匹配度。

- 如果设为 0.5:系统搜到的知识片段,相似度必须达到 50% 以上才会送给 AI。如果相似度只有 20%,系统会认为这属于“强行匹配”,直接扔掉。

- 防止 AI “一本正经地胡说八道”。如果不设阈值,即便库里完全没有相关知识,AI 也会强行抓几个最不沾边的段落来回答。

举例:假设你问:“WordPress 怎么联系站长?”

- 系统先根据 Top K 选出前 3 名候选项。

- 然后根据 Score 阈值 检查这 3 名:

- 第一名:相似度 0.9(合格)

- 第二名:相似度 0.7(合格)

- 第三名:相似度 0.3(不合格,被踢出)

- 结果: 最终只有 2 段高质量的知识会被递交给 AI。

上面这些参数都设置好了就点击处理按钮,然后它就对你的资料进行处理,可能会花一些时间。

处理好之后点击【前往文档】查看,这样我们一个知识库就已经做好了。

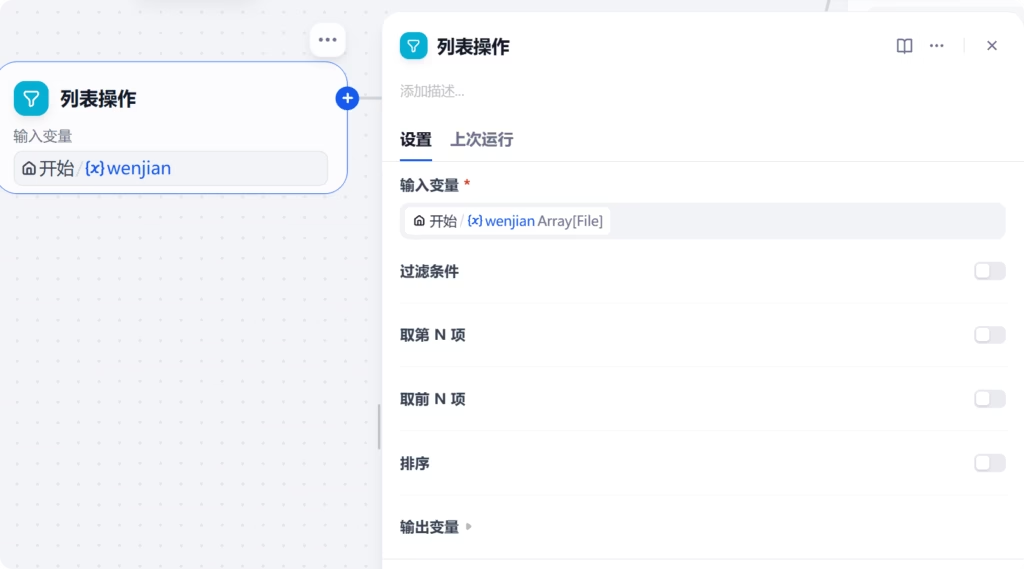

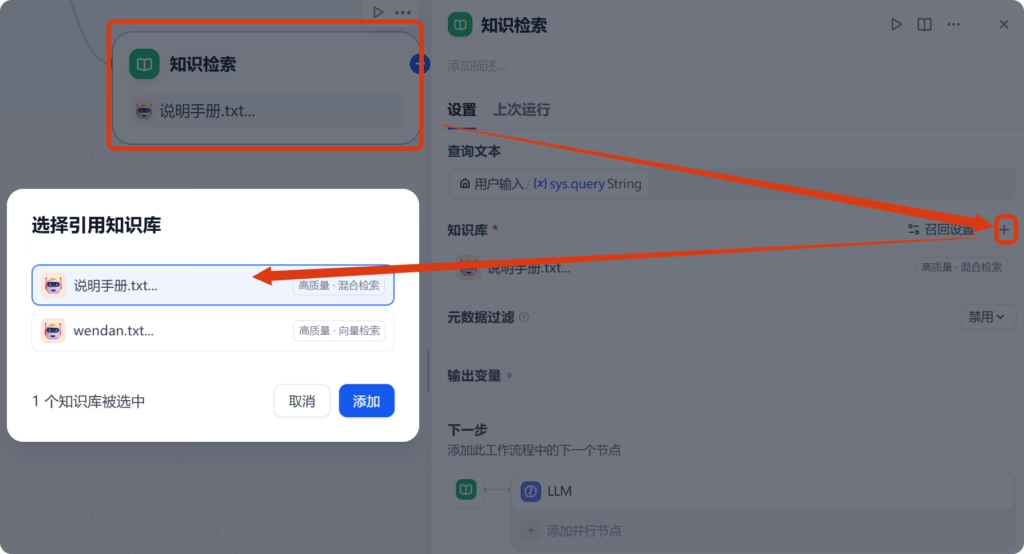

二. 知识检索节点

有了知识库,接下来需要在工作流当中使用——知识检索节点。

2.1什么是知识检索节点?

简单来说,它的作用是:接收用户的问题 -> 查阅选定的知识库 -> 抓出最相关的内容 -> 输出给后续节点(通常是 LLM 大模型)。

2.2 参数

- 查询文本:也就是用什么内容去检索资料库,一般选择开始节点中用户输入的内容。

- 知识库:就是我们前面创建的。

它的参数不多,但是后面引用知识库的时候也要注意。

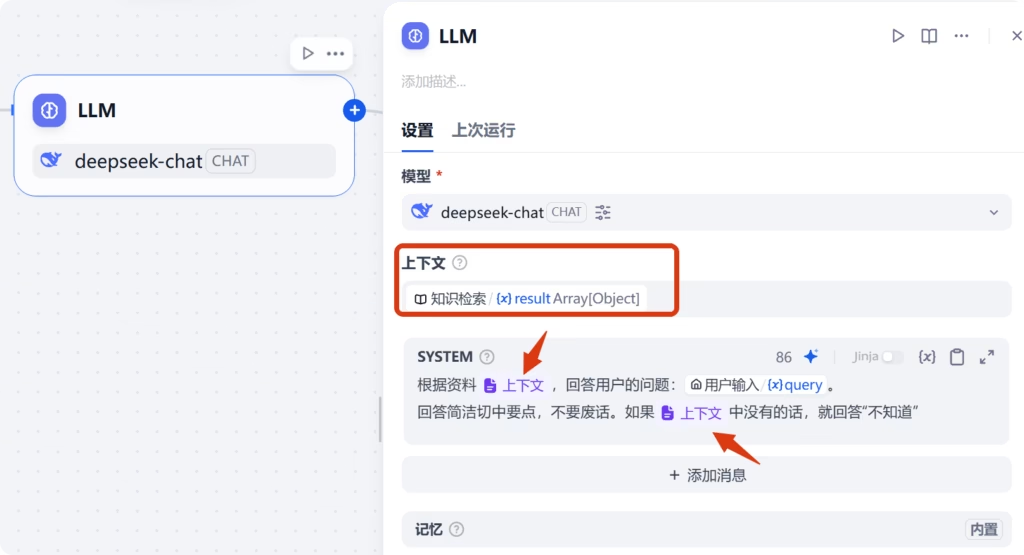

2.3 LLM节点中引用

将 “知识检索” 的输出端,连向 “LLM” 节点的输入端。

上下文里选择知识检索的输出(result),并且在下面的SYSTEM提示词里也要引用上下文,也就是上面截图中紫色的。

如果你只希望AI大模型根据资料中的内容回答的话,在 LLM 的提示词框里一定要加上:

“你是一个专业的建站助手。请根据以下提供的【背景知识】来回答用户的问题。如果【背景知识】里没有相关内容,请诚实告知。

【背景知识】:

{{context}} <– 这里引用刚才的检索结果变量

用户问题:{{sys.query}}”

三. 常见问题

- 回答没用上知识库: 检查 LLM 节点的“上下文”里是否真的引用了检索节点的输出。

- 搜出来的东西不准: 回去知识库调高 Rerank 的优先级,或者检查分段长度是否切得太碎,导致信息不完整。

- 总是提示“未找到相关内容”: 检查你的 Score 阈值 是不是设得太高了(比如设了 0.8),可以尝试调低或直接关闭。

知识检索节点是连接“你的私人数据”和“AI 大脑”的重要桥梁。你只需要记住:选对输入(用户问什么)、选对知识库、在LLM引用。

© 文章版权归白小菌所有,🫰欢迎转发分享。未经允许请勿抄袭转载。